突破性技术正在改变盲人或弱视人士探索周围世界的方式。

微笑听起来像什么? 这个问题一直困扰着世界机器和人类感知领域前沿的专家们;而现在,它正在推动为盲人或弱视人士设计的新一代仿生眼镜的研发。

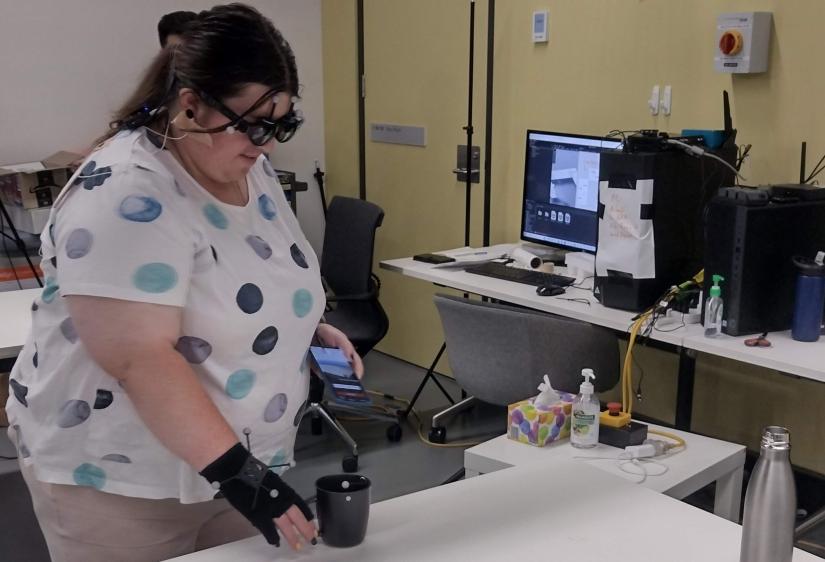

这项名为 ARIA 的可穿戴技术是悉尼初创公司 ARIA Research 以及悉尼科技大学(University of Technology Sydney)和悉尼大学研究人员多年辛勤工作的成果。与盲人社区(包括回声定位学专家Daniel Kish)共同合作设计的ARIA技术结合了视觉感知、空间理解和本体感受协调,帮助人们通过声音“看”世界。

“我们希望通过两种主要方式帮助用户了解环境:环境是什么样子,然后环境中的具体物体是什么?” 悉尼科技大学研究教授(UTS Research Professor)Chin-Teng Lin 介绍。他是脑机接口研究的全球领导者,也是该项目人类感知团队的领导者。

图片来源: ARIA Research

通过声音重获视觉

ARIA是一种非侵入性设备,可以像普通眼镜一样佩戴。它配备了摄像头和其他传感器,可以收集周围环境和其中物体的数据;这些信息通过提示音频传输,帮助用户将周围世界可视化。

想象一下 ARIA 用户到朋友家喝咖啡的场景。 ARIA 的音频信息为用户介绍房屋布局和其在空间内的位置,使他们能够独立在陌生环境中行动无阻。

当他们坐在沙发上时,系统会为他们面前咖啡桌上的每个物体提供音频提示, 例如:电话的提示是手机振动的嗡嗡声,而植物的提示是树叶在微风中沙沙作响的声音。

提示的音量表明用户与每个物体的接近程度,这意味着他们可以根据自己对自己空间位置的理解伸出手来触摸它们。如果他们转动身体,音频信号和音量就会调整以反映位置的变化。该技术还将描述其视线内环境的其他方面。

这种技术被成为“感官增强”,也是 ARIA 在辅助技术领域众多项目中如此与众不同的关键所在:该设备通过增强用户的其他感官(特别是听觉和触觉),以帮助渲染周围的世界。

图片来源: ARIA Research

声音的交响曲

虽然 ARIA音频语言的具体细节目前仍处于严格保密状态,但首席产品官兼联合创始人Mark Harrison介绍,它部分借鉴了管弦乐的节奏和结构。

“当两个人同时说话时,我们很听懂他们到底在说什么——但我们可以毫无问题地听懂交响乐、以及弦乐器、木管乐器与打击乐器同时演奏时的混声,”他介绍道。

这是一个优雅的概念,但将其转化为可应用技术是一个复杂的过程。 Lin教授与研究团队面临的主要挑战之一是创造一个可以根据每个用户的“脑力负荷”(即大脑处理信息工作量的可承受程度)进行调整的语言系统。

因此,研究团队正在研发一种用于该眼镜的感官解决方案,该解决方案将测量精神负荷的各种指数,例如心率或呼吸频率变化,并调整系统传输的信息量以优化用户体验。

“如果用户正在经历较高的脑力负荷,我们将提供尽可能简单的信息。如果他们的脑力负荷较低,我们就可以提供更多信息,以便他们能够更深入地了解周围环境。”Lin教授讲解道。

拍摄:Howe Zhu

让不可能成为可能

迄今为止,研究人员已经成功研制了一个原型,可以感知和识别多达 120 个物体,并帮助用户进行一系列寻路和避障活动。该技术的试点临床试验将于今年晚些时候进行。

虽然已经取得了阶段性的进展, 但相关研发工作还远未完成。接下研发团队将继续开发其他功能,包括从地形和象征角度理解环境;以及该领域的巅峰:非语言交流。

识别和传达点头、眼神交流与面部表情的这个想法来自于一位ARIA早期测试人员的启发。

“他说,‘Rob,我今年 38 岁了。 我有两个十几岁的孩子。 我总是能听到他们打架,但我永远听不到他们微笑。”ARIA 首席执行官兼联合创始人 Robert Yearsley 回忆道。

“这深深触动了我;我当时想,我们应该去实现它。”

该研究由澳大利亚政府生物医学技术视野4计划(BioMedTech Horizons 4 Programme)与合作研究中心项目计划(Cooperative Research Centre Projects)资助。

UTS研究团队

- 杰出教授 Chin-Teng Lin 联合主任,澳大利亚人工智能研究所,UTS

- 副教授 Teresa Vidal Calleja 研究主任, 机器人技术研究所, UTS

- Avinash Singh博士 讲师,计算机学院,UTS

- Vincent Nguyen博士 讲师,视轴矫正学, UTS

- Howe Zhu博士 研究助理, UTS